- 一、问题

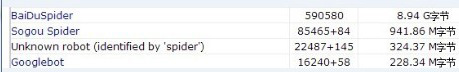

因某些原因,搜索引擎蜘蛛抓取网站占用很大流量,如图:

网站访问日志也可看见很多蜘蛛爬行记录。

二、认识、学习

我们知道,搜索引擎都遵守互联网robots协议,可通过robots.txt来进行限制。先对robots.txt一些实例说明,然后根据上面网站情况进行规则设置,通过上面截图可以看出BaiDuSpider占用流量非常大,首先在网站跟目录下面建立一个robots.txt文件。

例1. 禁止所有搜索引擎访问网站的任何部分

User-agent: *

Disallow: /

例2. 允许所有的robot访问 (或者也可以建一个空文件 “/robots.txt” file)

User-agent: *

Allow:

例3. 禁止某个搜索引擎的访问(禁止BaiDuSpider)

User-agent: BaiDuSpider

Disallow: /

例4. 允许某个搜索引擎的访问

User-agent: Baiduspider

allow:/

例5.禁止二个目录搜索引擎访问

User-agent: *

Disallow: /admin/

Disallow: /install/

例6. 仅允许Baiduspider以及Googlebot访问

User-agent: Baiduspider

Allow: /

User-agent: Googlebot

Allow: /

User-agent: *

Disallow: /

例7. 禁止百度搜索引擎抓取你网站上的所有图片

User-agent: Baiduspider

Disallow: /*.jpg$

Disallow: /*.jpeg$

Disallow: /*.gif$

Disallow: /*.png$

Disallow: /*.bmp$

- 问题解决(规则设置)

根据以上实例,经过分析网站日志,主要是百度抓取图片占用了流量,他还有两个目录也不希望搜索引擎抓取,设置规则如下解决:

User-agent: * Disallow: /admin/Disallow: /install/User-agent: Baiduspider

Disallow: /*.jpg$

Disallow: /*.jpeg$

Disallow: /*.gif$

Disallow: /*.png$

Disallow: /*.bmp$

因为搜索引擎索引数据库的更新需要时间。虽然蜘蛛已经停止访问您网站上的网页,但百度搜索引擎数据库中已经建立的网页索引信息,可能需要数月时间才会清除。也就是说设置限制之后日志还会看见蜘蛛爬行,逐渐会降低抓取直到完全生效,这种问题会持续一段时间。如果您需要尽快屏蔽,访问以下帮助中心进行投诉,搜索引擎就会较快处理。

- 知识加强

为更详细了解蜘蛛爬行原理和robots.txt写法,建议详细阅读以下标准资料:

BaiDuSpider帮助中心 http://www.baidu.com/search/spider.html

Googlebot帮助中心 http://support.google.com/webmasters/bin/answer.py?hl=zh-Hans&answer=182072

Sogou Spider帮助中心 http://www.sogou.com/docs/help/webmasters.htm

Robots.txt 详细介绍:http://baike.baidu.com/view/1280732.htm

baidu提供标准robots.txt写法:http://www.baidu.com/search/robots.html